Les modèles d’intelligence artificielle ne lisent pas les mots comme un humain. Ils les découpent, les numérotent, les analysent fragment par fragment. Cette mécanique de fond, appelée tokenisation, conditionne tout : la qualité des réponses, la vitesse de traitement, et le coût d’utilisation des API. Comprendre les tokens IA est devenu indispensable pour quiconque travaille avec ces outils au quotidien. Des développeurs de Taipei aux chercheurs en linguistique computationnelle, tous sont confrontés à cette réalité technique. Pourtant, elle reste largement méconnue du grand public.

Qu’est-ce qu’un token

Un token n’est pas un mot. C’est une unité linguistique minimale — parfois un mot entier, parfois une syllabe, parfois un simple signe de ponctuation. Les modèles comme GPT-4, LLaMA ou Copilot ne traitent jamais un texte brut : ils le découpent d’abord en ces blocs élémentaires avant de pouvoir l’analyser. Le mot « intelligence » peut ainsi constituer un seul token dans certains modèles, ou être scindé en deux dans d’autres. Un emoji, lui, compte souvent pour un token à part entière.

Cette granularité varie selon l’architecture du modèle, sa langue d’entraînement dominante et les choix techniques de ses concepteurs. En pratique, un texte en français génère davantage de tokens qu’un texte équivalent en anglais, parce que les modèles sont majoritairement entraînés sur des corpus anglophones. Pour les entreprises et développeurs taïwanais qui travaillent en mandarin traditionnel (繁體中文), cette réalité a un impact direct sur les coûts et les performances.

Pourquoi des tokens et pas des mots

La question paraît évidente, et pourtant la réponse est loin d’être simple. Un mot semble être l’unité naturelle du langage — mais pour une machine, il pose un problème fondamental : le vocabulaire humain est infini et imprévisible. Les néologismes, les fautes d’orthographe, les noms propres, les mots composés, les termes techniques ou les expressions dans des langues rares rendent impossible la construction d’un dictionnaire exhaustif. Le token résout ce problème autrement. En découpant les mots en fragments récurrents — des syllabes, des racines, des suffixes — le modèle peut traiter n’importe quel texte, même inconnu, à partir d’un vocabulaire fini et maîtrisé. Le mot « tokenisation » devient ainsi deux ou trois tokens distincts, là où un système basé sur les mots entiers serait bloqué face à un terme qu’il n’a jamais rencontré.

Il y a aussi une raison mathématique : les modèles de langage raisonnent sur des probabilités. Plus l’unité de base est petite et régulière, plus les calculs statistiques sont stables et efficaces. Un token de quelques caractères apparaît des milliers de fois dans les données d’entraînement ; un mot rare ou une expression spécifique, peut-être jamais. Enfin, les tokens permettent une neutralité entre les langues : l’arabe, le mandarin traditionnel (繁體中文) ou le finnois n’ont pas les mêmes structures que l’anglais. Découper en sous-unités universelles permet au modèle de traiter toutes ces langues avec le même moteur, même si — comme pour le mandarin utilisé à Taïwan — certaines restent structurellement plus coûteuses en tokens que d’autres.

Pourquoi pas des caractères non plus

Si les mots posent problème, on pourrait imaginer l’inverse : découper le texte caractère par caractère. Une lettre, un chiffre, un signe de ponctuation — l’unité la plus petite possible. La solution semble élégante sur le papier. En pratique, elle est inutilisable. Un modèle qui raisonne caractère par caractère doit traiter des séquences beaucoup plus longues pour exprimer la même information. La phrase « intelligence artificielle » représente 26 caractères contre seulement 3 à 4 tokens. À l’échelle de milliards de phrases d’entraînement, cette différence devient un gouffre computationnel : plus de calculs, plus de mémoire, plus de temps, pour un résultat inférieur.

Le problème va plus loin. Les modèles de langage apprennent en observant des patterns récurrents dans les données. Avec des caractères isolés, ces patterns sont trop courts et trop fragmentés pour capturer le sens. Le modèle verrait défiler des « i », des « n », des « t » — sans jamais percevoir que ces lettres forment ensemble un concept cohérent. Le token, lui, préserve une unité de sens minimale : assez petit pour être flexible, assez grand pour être porteur d’information. C’est précisément cet équilibre qui en fait la brique de base idéale. Ni trop grand comme le mot, ni trop petit comme le caractère — le token occupe le juste milieu entre expressivité linguistique et efficacité computationnelle.

La tokenisation, un processus en quatre temps

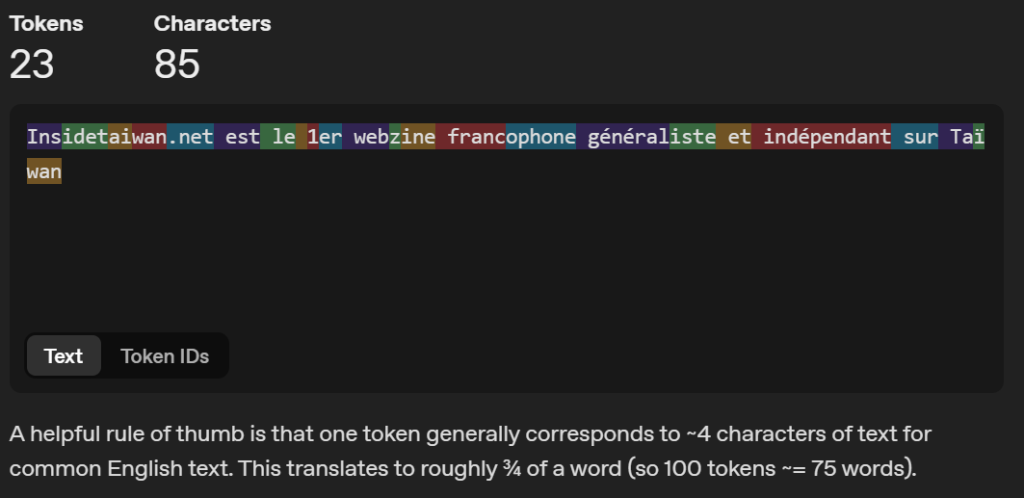

Transformer un texte en données exploitables ne se fait pas en un clic. La tokenisation suit un protocole précis, découpé en plusieurs étapes successives. La première est la normalisation : le modèle simplifie le texte, convertit les majuscules, filtre les caractères parasites et ramène les mots à leur forme de base. Vient ensuite le découpage effectif — l’étape où le texte est fragmenté selon les règles apprises lors de l’entraînement. La phrase « L’IA révolutionne les études de marché » produit 9 tokens avec GPT-4o, contre 11 pour GPT-4 classique et jusqu’à 15 pour GPT-3 : la différence illustre concrètement les progrès d’efficacité entre les générations.

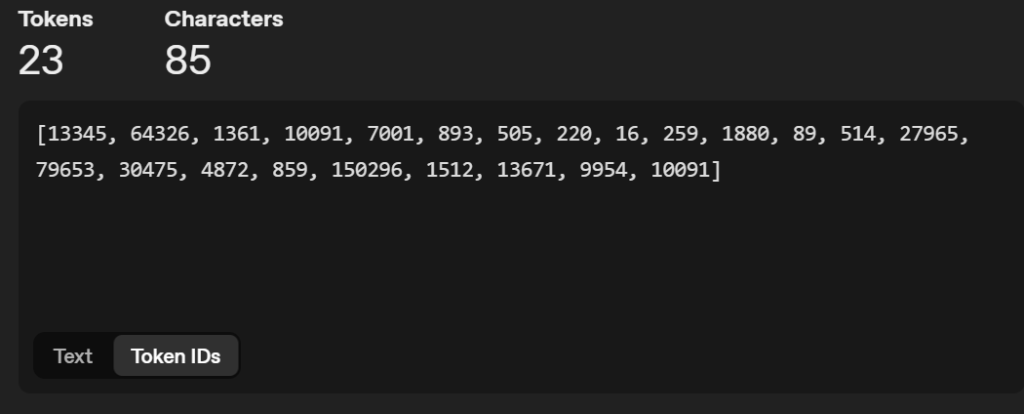

Chaque fragment reçoit ensuite un identifiant numérique unique — le token ID — qui constitue en quelque sorte le vocabulaire interne du modèle. Enfin, le modèle analyse les relations entre tous ces identifiants pour construire une réponse cohérente, en s’appuyant sur des probabilités statistiques plutôt que sur une compréhension sémantique humaine. C’est ce mécanisme, répété des milliards de fois à l’entraînement, qui donne l’illusion d’une machine qui « comprend ».

Compter ses tokens pour maîtriser ses coûts

Pour les entreprises qui accèdent aux modèles via API, les tokens ne sont pas qu’un concept technique : ils représentent une ligne budgétaire directe. La quasi-totalité des fournisseurs — OpenAI, Anthropic, Google — facturent au nombre de tokens consommés, en entrée comme en sortie. Un texte de 337 caractères produit, par exemple, 67 tokens avec GPT-4o. À l’échelle d’une application traitant des milliers de requêtes quotidiennes, l’optimisation des prompts devient un levier économique réel.

Des outils comme OpenAI Tokenizer permettent de visualiser précisément le découpage d’un texte et d’anticiper les coûts avant déploiement. Chaque modèle impose également une limite maximale de tokens par requête — GPT-4 plafonne à 32 768 tokens, ce qui contraint la longueur des documents analysables en une seule fois. Pour les startups technologiques installées dans le district de Zhongzheng/Xinyi (中正區/信義區) à Taipei, qui intègrent des LLM dans leurs produits, cette contrainte technique influence directement les choix d’architecture logicielle.

Les images, un cas à part dans le comptage des tokens

Les images ne s’expriment pas en mots, mais les modèles d’IA les convertissent quand même en tokens pour pouvoir les analyser. Le mécanisme est différent du texte, mais le principe reste le même : chaque image consomme un quota, parfois très élevé. Chez Google, une image standard de 1 024 x 1 024 pixels est comptabilisée à 1 290 tokens. Plus la résolution est haute, plus la facture en tokens grimpe. Sur les versions gratuites, cela change concrètement l’expérience : envoyer plusieurs images dans une même conversation peut épuiser rapidement la fenêtre de contexte disponible, au détriment du texte échangé.

Certaines plateformes, comme ChatGPT Free, restreignent d’ailleurs l’analyse d’images de manière stricte, indépendamment des tokens. D’autres, comme Gemini 2.5 Flash, acceptent images, audio et vidéo dans leur tier gratuit — mais chaque fichier pèse lourd dans le compteur. La règle à retenir : une image n’est jamais « gratuite » en tokens. Sur un modèle limité à 8 000 tokens en entrée, deux ou trois photos haute résolution peuvent suffire à saturer l’intégralité du contexte disponible, avant même d’avoir tapé la moindre question.

Taïwan face à l’enjeu des langues sous-représentées

Taïwan occupe une position particulière dans l’écosystème mondial de l’IA. L’île est à la fois un acteur industriel majeur — via TSMC (台積電) qui fabrique les puces sur lesquelles tournent ces modèles — et un territoire linguistique spécifique, où le mandarin traditionnel cohabite avec le taïwanais, l’hakka et les langues austronésiennes. Or la tokenisation pénalise structurellement les langues peu représentées dans les données d’entraînement.

Un même contenu exprimé en mandarin traditionnel consomme davantage de tokens qu’en anglais, ce qui se traduit par des coûts plus élevés et parfois une qualité de réponse moindre. Des équipes de recherche à l’Université nationale de Taïwan/NTU (國立臺灣大學) et à l’Academia Sinica (中央研究院) travaillent sur des modèles mieux calibrés pour les langues locales. L’enjeu est double : réduire les coûts pour les entreprises taïwanaises, et s’assurer que les outils IA reflètent fidèlement les nuances culturelles et linguistiques de l’île.

ChatGPT, Claude, Gemini… combien de tokens dans la version gratuite ?

Voici un tableau récapitulatif basé sur les données disponibles en avril 2026. Une précision importante d’abord : la notion de « tokens en entrée/sortie » pour les versions gratuites grand public (interfaces web) n’est généralement pas communiquée sous forme de limites de tokens précises — les plateformes préfèrent parler de nombre de messages ou de fenêtre de contexte. Le tableau ci-dessous distingue donc les deux dimensions clés : la fenêtre de contexte (tokens en entrée) et la limite de réponse (tokens en sortie), là où les données sont disponibles.

| IA générative | Modèle gratuit | Tokens en entrée (contexte) | Tokens en sortie (réponse) | Notes |

|---|---|---|---|---|

| ChatGPT (OpenAI) | GPT-5.2 | ~8 000 tokens | ~4 000 tokens | GPT-5 Free supporte environ 8 000 tokens en entrée ; bascule sur GPT-5.2-mini après 10 messages / 5h |

| Claude (Anthropic) | Claude Haiku 4.5 | ~32 000 tokens | ~4 096 tokens | Accès limité en nombre de messages ; pas de limite de tokens publiquement documentée pour le tier gratuit |

| Gemini (Google) | Gemini 2.5 Flash | ~1 000 000 tokens | ~8 192 tokens | Gemini 2.0 Flash est accessible gratuitement avec une fenêtre de contexte de 1 million de tokens |

| Mistral (Le Chat) | Mistral Small | ~32 000 tokens | ~8 192 tokens | Le Chat, l’interface web de Mistral, est gratuit pour usage personnel avec des limites plus généreuses que l’API |

| Copilot (Microsoft) | GPT-4o | ~128 000 tokens | ~4 096 tokens | Basé sur GPT-4o via Bing ; pas de limite de tokens documentée pour le grand public |

| DeepSeek | DeepSeek V3 | ~128 000 tokens | ~8 192 tokens | Interface web gratuite ; DeepSeek V3.2 plafonne à 128 000 tokens de contexte |

| Grok (xAI) | Grok 3 | ~131 072 tokens | ~8 192 tokens | Gratuit via X (anciennement Twitter) ; accès limité en nombre de requêtes quotidiennes |

| Perplexity | Perplexity Free | ~200 000 tokens | ~4 096 tokens | La fenêtre de contexte est de 200 000 tokens sur Sonar ; orienté recherche web |

| Meta AI (Llama 4) | Llama 4 Scout | ~128 000 tokens* | ~8 192 tokens | Accès via l’app Meta ou WhatsApp ; Llama 4 Scout est accessible via Groq gratuitement avec 30 req/min |

| Qwen (Alibaba) | Qwen 3 32B | ~128 000 tokens | ~8 192 tokens | Accès via Hugging Face ou l’app Qwen ; modèle open-source, usage web gratuit |

⚠️ Important à savoir

Quelques précisions indispensables pour lire ce tableau correctement :

- Les chiffres de tokens en sortie sont des maximums théoriques, souvent bridés par les plateformes gratuites bien en dessous de la limite technique du modèle

- La fenêtre de contexte inclut l’historique de conversation + le prompt + la réponse — ce n’est pas uniquement votre question

- La fenêtre de contexte affichée dans le marketing ne correspond pas toujours à la réalité en interface web : Gemini, par exemple, limite les échanges à environ 32 000 tokens dans l’application grand public, malgré un modèle capable de traiter 1 million de tokens

- Les limites changent fréquemment ; vérifier directement sur le site de chaque éditeur reste la méthode la plus fiable

L’essentiel à retenir

- 🧩 Un token est la plus petite unité traitée par un modèle IA — ni un mot, ni une lettre, mais un fragment variable selon le modèle utilisé

- 💸 Les coûts API sont directement proportionnels au nombre de tokens consommés, en entrée et en sortie

- 🔢 GPT-4o traite un texte de 337 caractères en seulement 67 tokens, contre davantage pour les versions antérieures

- 🌏 Le mandarin traditionnel génère structurellement plus de tokens que l’anglais, ce qui désavantage les utilisateurs taïwanais sur le plan économique

- 🔬 Des institutions comme l’Academia Sinica travaillent à développer des modèles mieux adaptés aux langues et cultures de Taïwan

A lire également sur Insidetaiwan.net

🌏✨ Envie d’un voyage à Taïwan sur-mesure et sans stress ? Cliquez, lancez une visio avec un expert local Planexplora et construisez votre itinéraire en direct ! 🚀

🤝 Programme d’affiliation 🤝

📌 Certains liens de cet article, ainsi que certaines images, renvoient vers des liens sponsorisés, permettant à Insidetaiwan.net de toucher une commission en cas d’achat, sans aucun coût supplémentaire pour vous. 💰 Cela nous aide à financer le magazine et à continuer à vous offrir un contenu indépendant et de qualité. 📖✨

💞 Soutenez-nous 💞

- ⏯ Nous soutenir #financièrement

- ⏯ S’inscrire à nos #Newsletters

- ⏯ Nous suivre sur nos #réseaux sociaux

- ⏯ Devenir #partenaire

- ⏯ Proposer des #articles et du #contenu

- ⏯ Découvrir nos offres #professionnelles (Publicités, Conseils…)

Pour découvrir nos offres rendez-vous sur la page dédiée (Nous soutenir) ou contactez-nous pour collaborer avec nous.